【CVPR2024】阿里云人工智能平台PAI图像编辑算法论文入选CVPR2024

近期,阿里云人工智能平台PAI发表的图像编辑算法论文在CVPR-2024上正式亮相发表。论文成果是阿里云与华南理工大学贾奎教授领衔的团队共同研发。CVPR(计算机视觉与模式识别会议)是计算机视觉和模式识别领域的顶级国际会议,旨在展示最新的研究进展和技术成就,推动这一领域理论与应用的前沿进展,并通过精选提交的高水平学术论文和实践工作,对学术界和工业界产生深远的影响。此次入选标志着阿里云人工智能平台PAI自主研发的图像编辑算法达到了先进水平,赢得了国际学术界的认可。在阿里云人工智能平台PAI算法团队和华南理工大学的老师学生们一同的坚持和热情下,将阿里云在图像生成与编辑领域的先进理念得以通过学术论文和会议的形式,向业界传递和展现。

基于文本引导的图像编辑任务允许用户使用简单的文字描述来指导修改一幅图像,无需具备复杂的图像编辑软件或专业知识即可实现编辑效果。用户可以通过输入文本对图像进行涉及颜色变更、物体添加或去除、风格转换等多种编辑的操作。这种交互式的编辑方式大大降低了图像编辑的门槛,使得创意表达更加便捷和个性化。

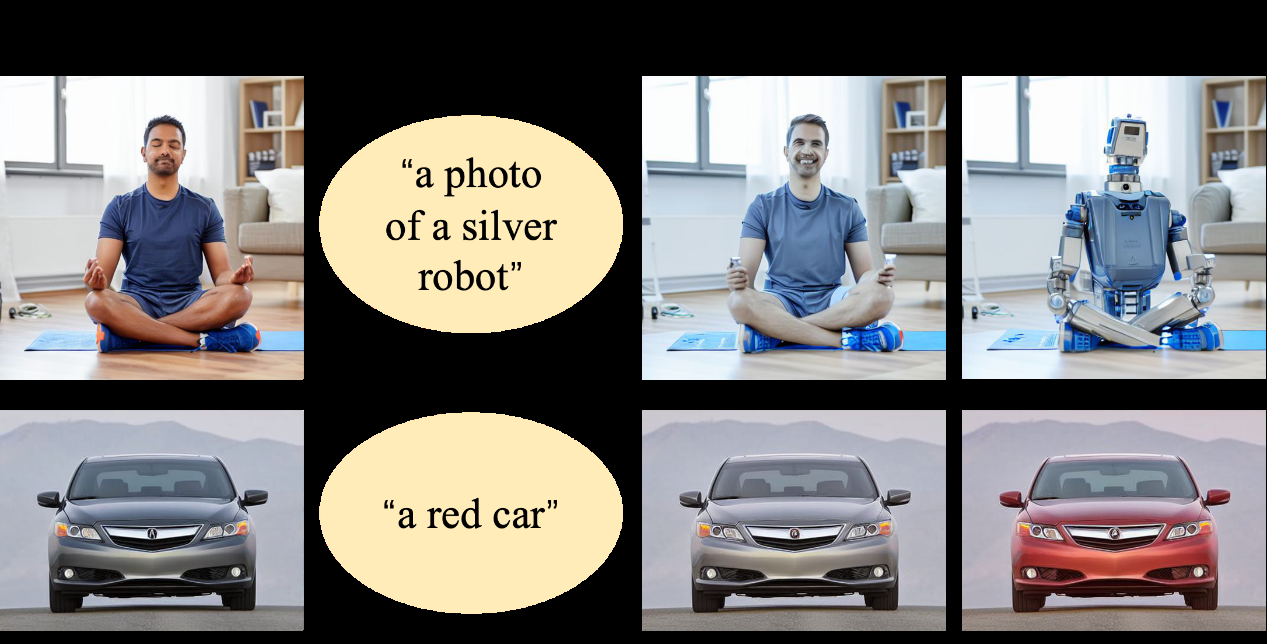

目前的一些先进图像编辑方法,例如Prompt-to-Prompt(P2P),通过替换与目标编辑术语相对应的源提示中的交叉注意力图来改变图像的特定区域。而Plug-and-Play(PnP)策略则是先从注意力层提取原始图像的空间特征和自注意力,再将它们注入到目标图像的生成过程中。在这些技术中,注意力层对于控制图像布局以及确立输入提示与生成图像之间的关联起着至关重要的作用。但是,对注意力层的不恰当调整可能会带来意外的编辑结果或者编辑失败。例如,在交叉注意力层进行编辑时,真实图像可能因此而失去预期效果,如尝试将人类编辑成机器人或将汽车颜色变更为红色的编辑尝试可能不会成功。

图1. 图像编辑的失败案例以及我们提出的方法成功编辑的结果

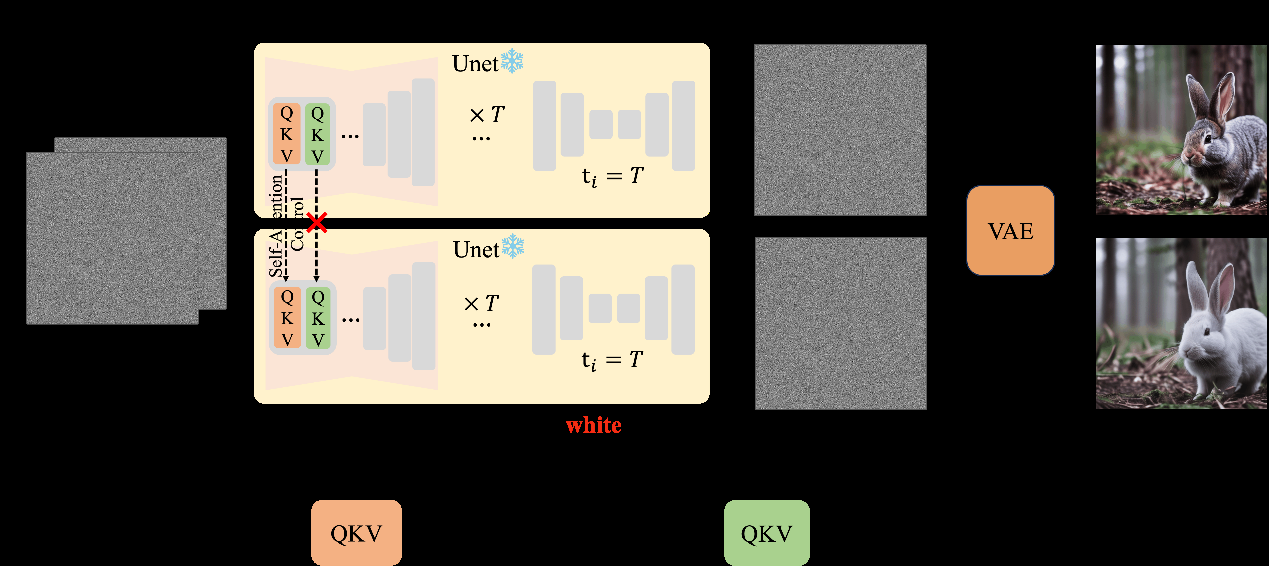

在我们的研究中,我们介绍了一种名为Free-Prompt-Editing(FPE)的简洁而高效的算法。FPE通过在去噪阶段替换指定注意力层的自注意力图进行图像编辑,这一过程中解放了需要源提示的限制,这对实际的真实图像编辑场景极有价值。总体来说,我们的研究促进了对稳定扩散(Stable Diffusion)中注意力图的理解,并针对文本引导的图像编辑(Text-Image-Editing,简称TIE)提供了切实可行的解决策略。图2展示了FPE算法在合成图像上实施编辑的具体过程。

图 2:Free-Prompt-Editing 在对合成图像进行编辑的过程示意图

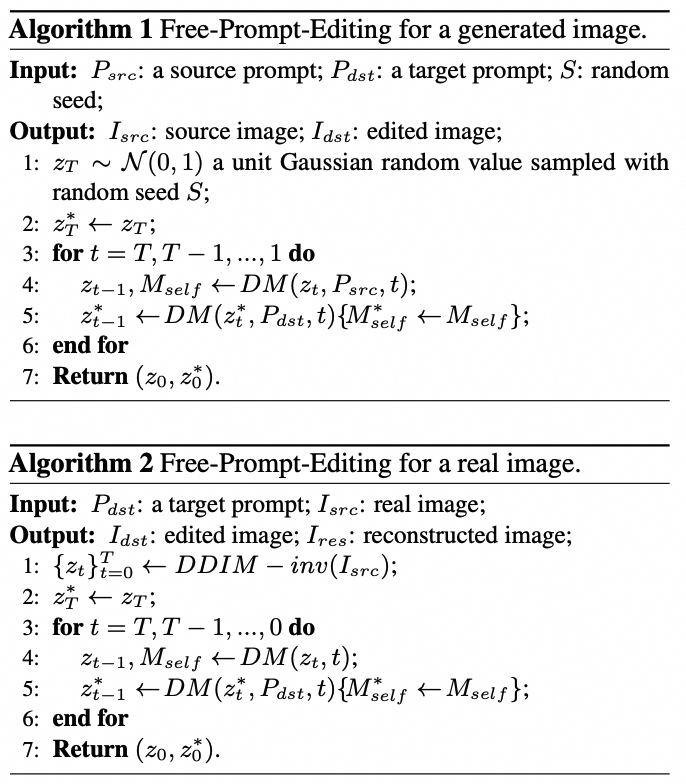

Free-Prompt-Editing伪代码如下:

图 3:Free-Prompt-Editing 在合成图像编辑和真实图像编辑场景下的伪代码

图4展示了FPE的编辑结果,它成功地转换了原始图像的各种属性、风格、场景和类别。

图 4:Free-Prompt-Editing 编辑结果示例

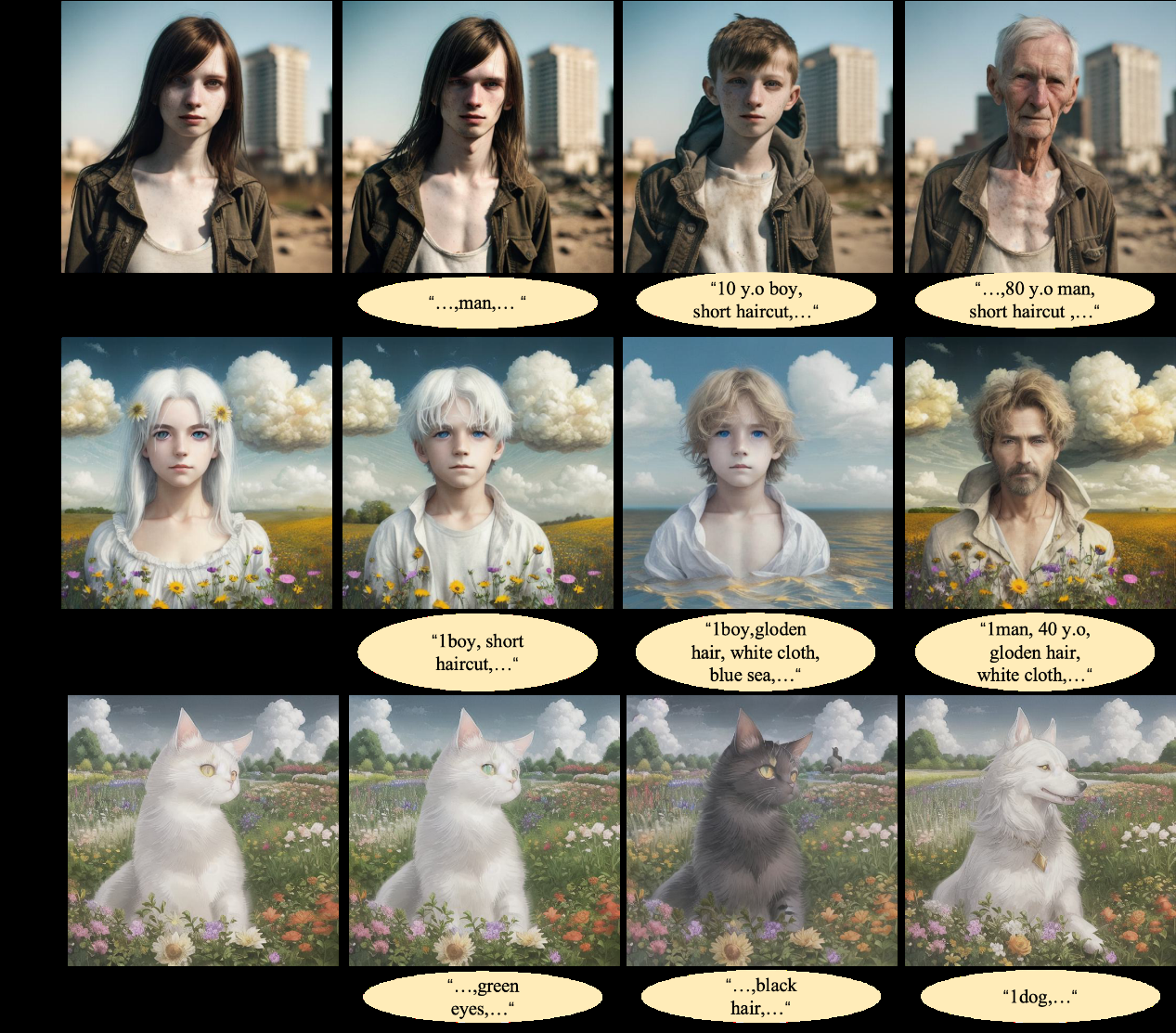

图5呈现了FPE技术应用于基于稳定扩散算法的其他定制模型中的编辑效果。观察这些成果,我们可以发现FPE技术能够高效地适用于各种扩散模型。它不仅成功实现了性别转换,把女孩变为男孩,还能够调整人物的年龄,使男孩呈现出10岁或80岁的特征;此外,它还能修改发型、变换头发色彩、替换背景乃至进行类别上的转变。

图 5:Free-Prompt-Editing 编辑结果示例

图6对比展示了FPE与其他一些SOTA图像编辑技术的效果。无论是对真实照片还是合成图像,FPE均展现出了高效的编辑能力。在所有的案例中,FPE都能够实现与描述提示高度一致的精细编辑,同时最大限度地保留了原图的结构细节。

图 6:Free-Prompt-Editing 与其他编辑方法的对比

为了更好地服务开源社区,这一算法的源代码即将贡献在自然语言处理算法框架EasyNLP中,欢迎各界从业人员和研究者使用。

阿里云人工智能平台PAI长期招聘正式员工/实习生。团队专注于深度学习算法研究与应用,重点聚焦大语言模型和多模态AIGC大模型的应用算法研究和应用。简历投递和咨询:chengyu.wcy@alibaba-inc.com。

论文信息

论文名字:Towards Understanding Cross and Self-Attention in Stable Diffusion for Text-Guided Image Editing

论文作者:刘冰雁、汪诚愚、曹庭锋、贾奎、黄俊

论文pdf链接:https://arxiv.org/abs/2403.03431